华为诺亚方舟实验室等研究机构的研究者联合提出了开创性的文本到图像(T2I)模型 PixArt-α。这个模型的训练时间只需要 Stable Diffusion v1.5 的 10.8%,大约是 675 天,而不需要像更大的 SOTA 模型 RAPHAEL 那样需要 6250 天,节省了近 30 万美元。此外,PixArt-α 的训练成本仅为 1%,并且支持直接生成高达 1024×1024 分辨率的高分辨率图像。

PixArt-α 模型不仅大幅降低了训练成本,还显著减少了二氧化碳排放,同时提供了接近商业应用标准的高质量图像生成。PixArt-α 的出现,为 AIGC 社区和初创公司提供了新的视角,以加速他们构建自己的高质量且低成本的生成模型。

为了实现这个目标,该研究提出了三个核心设计:

-

训练策略分解:该研究设计了三个独特的训练步骤,分别优化像素间依赖关系,文本图像对齐和图像美学质量;

-

高效的 T2I Transformer 结构:该研究将跨注意力模块整合到 Diffusion Transformer(DiT)中,以注入文本信息并简化计算复杂的类条件分支;

-

高信息密度数据:该研究强调文本图像对中概念密度的重要性,并利用大视觉语言模型自动标记密集的伪文本标签以协助文本图像对齐学习。

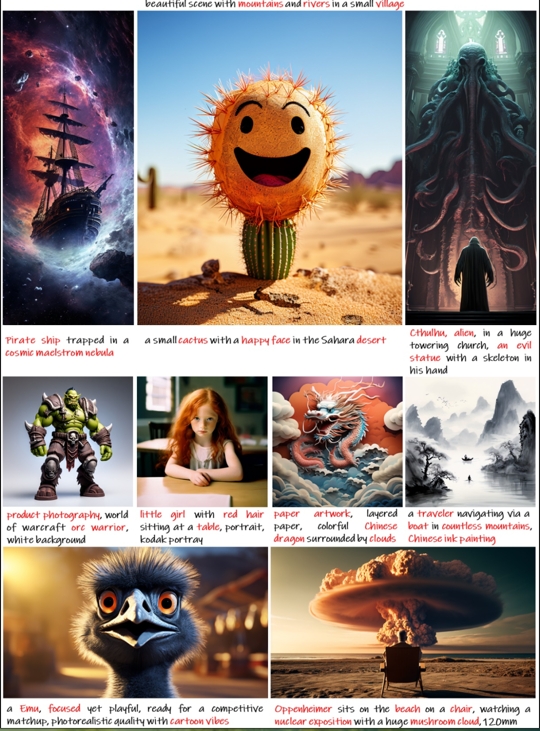

大量的实验表明,PixArt-α 在图像质量、艺术性和语义控制方面表现出色。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...