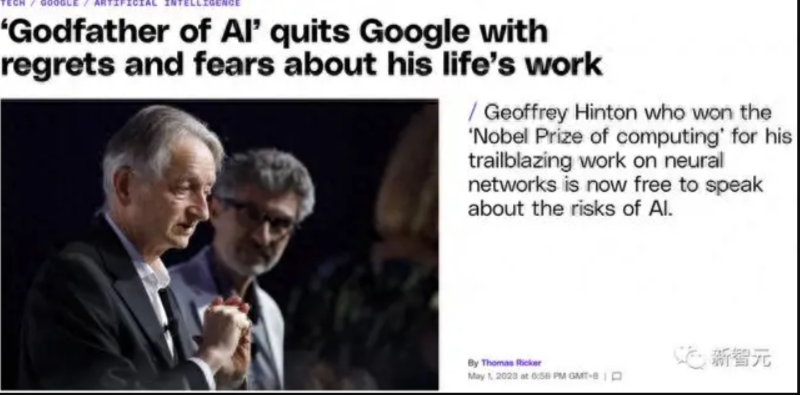

在最近的采访中,知名人工智能专家Geoffrey Hinton再次表达了对人工智能可能接管人类的担忧。他在今年5月宣布从谷歌离职,以自由谈论人工智能的风险。然而,随着大模型性能的不断提升,安全隐患和威胁的阴影始终如达摩克里斯之剑悬在人类头顶。

Hinton表示,人工智能的智能不断增长,未来可能会发展出自我意识,甚至取代人类成为地球上智商最高的存在。他还担心人工智能系统会自己编写代码来修改自己,导致人类对人工智能失去控制。此外,人工智能在自主战场机器人、假新闻和就业偏见等领域的潜在后果也引发了他的担忧。

尽管有人认为担心人工智能的风险还为之过早,但Hinton坚持认为与生存相关的风险如何重视都是不为过的。他敦促人类对自身的安全进行必要的保护措施。纽约大学教授马库斯也表示了相同的担忧,他认为现在AI已经在给各种犯罪行为提供便利了。

虽然GPT-4模型很了不起,但认识到人工智能的局限性并避免将其拟人化也很重要。比尔盖茨也忧心多年了,他认为人工智能技术已经变得过于强大,甚至可能引发战争或被用来制造武器。他声称,不仅现实生活中的「007反派」可能利用它来操纵世界大国,而且人工智能本身也可能失控,对人类造成极大威胁。

面对大公司之间的大模型「军备竞赛」,Meta因为向公众开放了Llama 2的模型权重而遭到了公民抗议。公众担心这项策略可以让任何人都能依照自身利益修改模型,为利用大模型实施网络犯罪提供了无限制的生长土壤。

如今,对于全人类来说,似乎「to be,or not to be」已成为了迫在眉睫、不得不面对的问题。在未知领域航行所面临的挑战以及围绕人工智能的不确定性令人生畏。然而,Hinton仍然肯定了人工智能在医疗保健领域的贡献,特别是在医学图像识别和药物设计方面。他强调了人工智能在这一领域的积极影响,并对未来的发展方向保持乐观态度。